Исследователи обнаружили новый тип взлома, который может сработать на голосовых цифровых помощниках, таких как Alexa от Amazon или Siri от Apple.

Атака получила название SurfingAttack. Она использует ультразвуковые волны, которые незаметны для человеческого уха, но могут восприниматься голосовым помощником. Такие ультразвуковые волны позволят злоумышленнику управлять помощником с относительно большого расстояния, при этом устройство даже не должно находиться в поле зрения. Ультразвуковые волны могут проходить через некоторые препятствия, например, через дверь или стекло.

«Люди ничего не слышат, но голосовые помощники будут интерпретировать эти ультразвуковые волны как голосовую команду и будут выполнять порученные им действия, — сказал Кибен Ян, доцент Мичиганского государственного университета. — Чтобы получить доступ к голосовому помощнику, есть много возможностей, например, когда люди кладут свои телефоны на стол и оставляют их без присмотра».

Ян сказал, что хакеры удаленно могут позвонить любому человеку из контактов, управлять домашними смарт-устройствами, заблокировать или разблокировать автомобиль или входную дверь, управлять термостатом, и многое другое. Такие атаки также могут сделать бесполезной двухфакторную аутентификацию, так как голосовой помощник может переслать хакеру код безопасности из СМС.

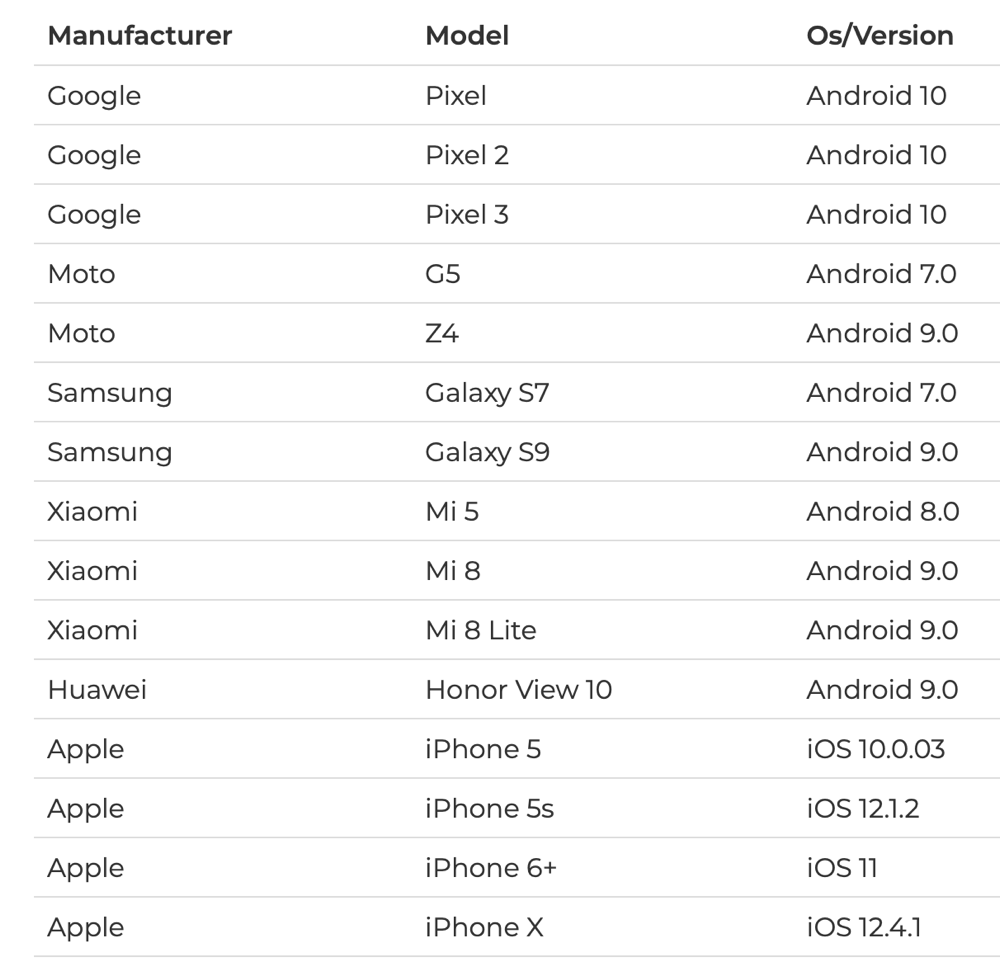

Используя простейшее оборудование, стоимостью менее $10, исследователи смогли успешно удаленно управлять следующими устройствами.

Исследователи отмечают, что пока хакеры не додумались до такого способа взлома, но это лишь вопрос времени. Чтобы предотвратить атаки, нужно отключать голосовую помощь, когда телефон заблокирован, и не оставлять устройство без присмотра.